(取自Meta官網)

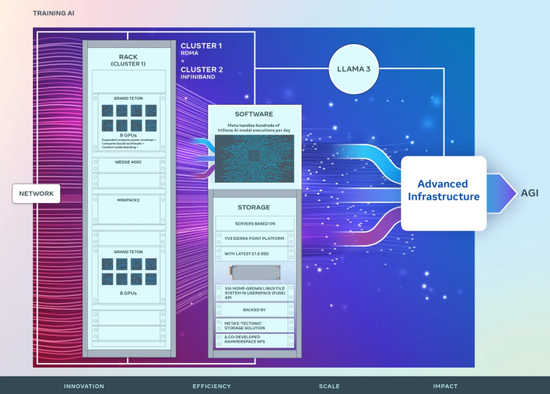

Meta 公司日前通過官方新聞稿公布了兩座新的數據中心集群,該公司正希望通過 NVIDIA 的 GPU,在以 AI 為重點的開發中脫穎而出。

據悉,這兩座數據中心的唯一目的,是在消費者特定應用領域,包含聲音或圖像辨識,進行 AI 研究和大語言模型的開發,每個集群都包含了 24576 塊NVIDIA H100 AI GPU,將用於自家大語言模型 Llama 3 的訓練。

兩座新建的數據中心集群都具有 400Gbps 互聯功能,其中一個集群採用了 Meta 基於 Arista 7800 自主開發的 Fabric 解決方案,而另一個集群則採用了 NVIDIA 的 Quantum2 InfiniBand Fabric,以確保無縫互連體驗。

此外,集群基於 Meta 自家的開放式 GPU Grand Teton AI 平台,可通過提高主機到 GPU 的頻寬和運算能力,充分利用現代加速器的功能。

Meta 官方表示,這些集群的高性能網路結構的效率及關鍵儲存決策、配合每個集群中的 H100 GPU,能夠為更大、更複雜的模型提供支持,為通用人工智慧產品開發、AI 研究的進步鋪路。

本文為品玩授權刊登,原文標題為「Meta 新建兩座數據中心集群:內含超 4.9 萬塊英偉達 H100 GPU」